こんにちは!株式会社Cosmowayが組織するデジタルプロダクション「factory4」のUIUXデザイナー新谷です。

今回は5月11日~12日にGoogle毎年恒例の開発者向けカンファレンス「Google I/O 22」が開催されました。そこで発表された、次期「Android OS」、「Google 3Dマップ」、「Google Wallet」、また進化した音声アシスタントや検索、セキュリティに関する多くの新機能の中から、とくにユーザー体験やUXデザインをするうえでポイントになりそうなものをまとめてみました。

Google Mapの没入型3Dマップ「immersive View」

Google Walletが復活しスマホのお財布になる

マルチ検索に場所情報が考慮された「Multisearch near me」

Googleアシスタントとの自然な会話と脱「OK, Google」

AIによる文書やMeetの要約機能

目次

注目機能1)Google Mapの没入型3Dマップ「immersive View」

まずはGoogleマップの新機能として、「Immersive View」が追加されました。何十億ものストリートビュー画像と航空写真を融合させて3D空間を構築し、指先だけで東京やロンドンなど一部の都市などの目的地を自在に動き回ることができ、没入感のある地図体験が可能になります。

たとえば、この機能では映像にあるように都市全体がシミュレートされます。ロンドンのウェストミンスター寺院を検索すると、上空から寺院の周辺を見回り、その中に入ったりすることもできます。これらはユーザーが投稿した写真など素材にもとづいて、アルゴリズムで自動生成するそうです。同時にアクセス手段や、混雑する時間帯などの情報も取得できます。この機能は年内にロサンゼルス、ロンドン、ニューヨークや東京などから順次展開されていく予定となっています。

メタバースの領域を別のアプローチで実現する!?

機能の本質からは少し外れますが、この「Immersive View」に関しては、この先の展開次第ではちょっとしたメタバースの領域に踏み込んでいくのではないかと感じました。3Dの空間を生み出すのに必要な詳細なデータやユーザー情報からストーリーやコンテンツにつなげることができれば、(Google Mapではユーザーが写真をアップし続けていますし)膨大な情報量とテクノロジーでGoogleは違ったアプローチでメタな世界を実現していくのではないかと思わされます。

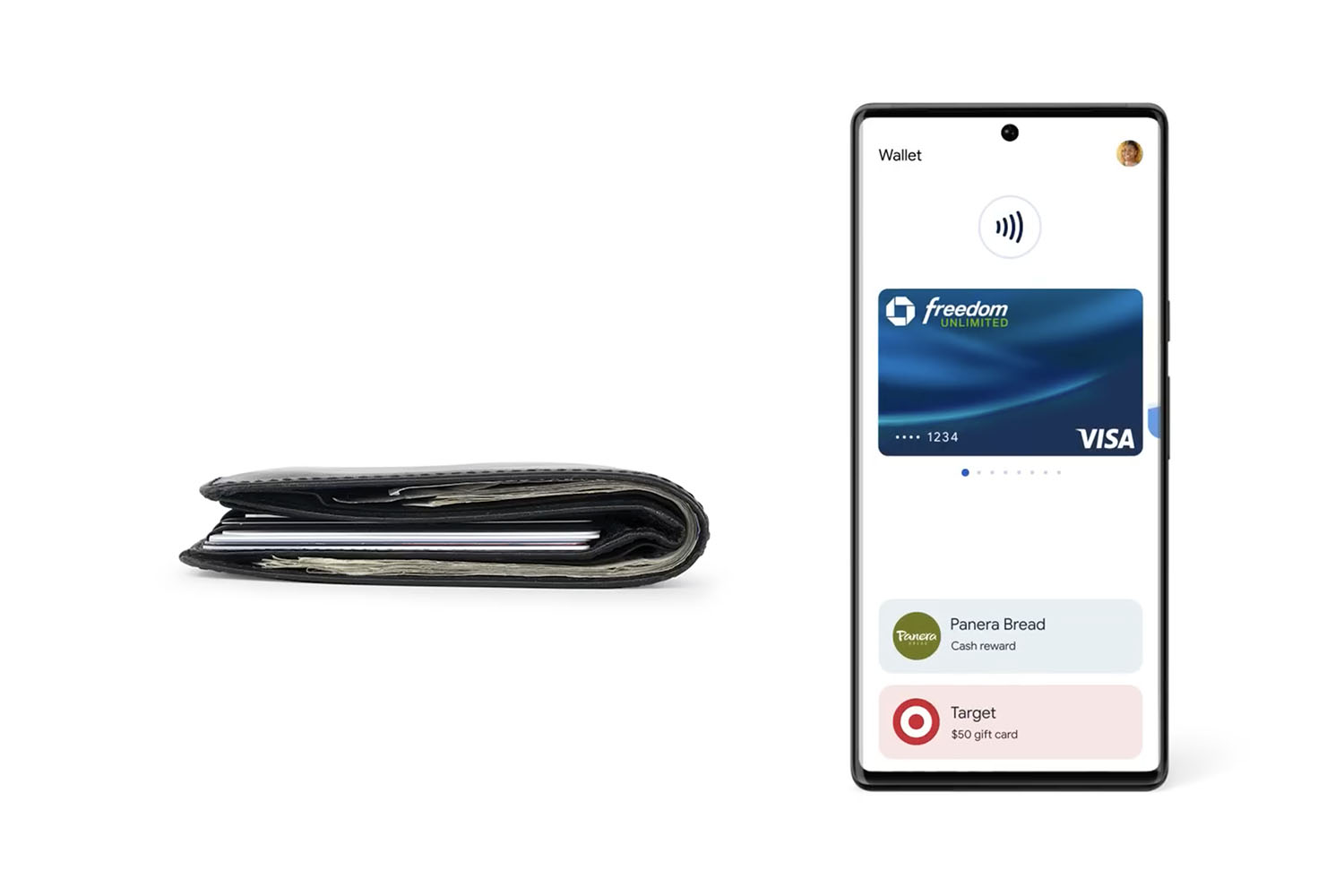

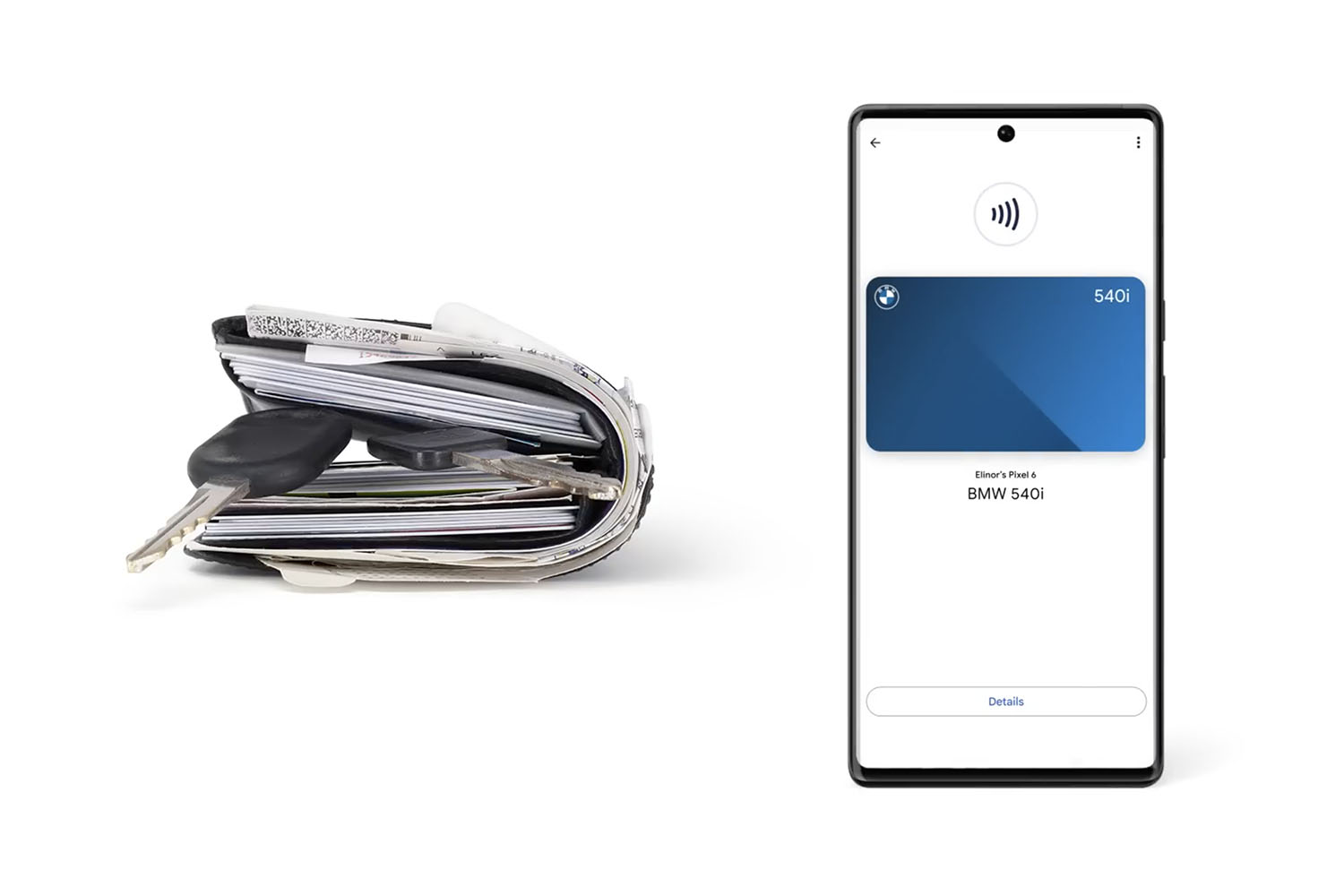

注目機能2)「Google Wallet」が復活しスマホのお財布になる

廃止されていた「Google Wallet」がAndroid向けの新たな決済サービスとして復活することになりました。

出典:Ask a Techspert: How do digital wallets work?

スマートフォンなど、デバイスにGoogle Walletがインストールされていれば、Google Payと同じく、クレジットカードやデビットカードと紐付けて決済に利用することができます。また、交通系ICカードや航空券、国によってはワクチン接種証明書やテーマパーク、イベントのチケットとして活用することも可能で、さらに学生証や自動車のキーを保存することもできます。

ただのお財布にとどまらないUXやセキュリティの向上

交通系カードをGoogle Walletに登録することで、Googleマップにて経路をチェックする際に残高が表示されたり、残高が少なくなったらカードに入金することができるなど、付随したサービスの向上が見込めます。

出典:Ask a Techspert: How do digital wallets work?

たとえば、登録された車やホテルのキーとして利用できたり、免許証、コンサートのチケットなど幅広く利用できます。しかしこれらにはメーカーやサードパーティーの対応も必要となるため、機能は順次展開されていくはずです。

セキュリティ面では、Androidのセキュリティ機能が提供されることによりデータは制御され、購入はすべて暗号化されます。紛失した場合には「端末を探す」機能により、遠隔操作でその場所を特定したり、端末をロックすることも可能です。

Google Walletは日本を含む40ヵ国にて今夏にリリースされる予定となっており、免許証や身分証明書がスマートフォンの中に保存し活用できるようになれば、ポケットの中のデバイスひとつでとてもスマートな「お財布レス」な生活がより現実的なものとなっていきます。(国によって提供されるサービスは異なります)

注目機能3)位置情報に対応した「マルチ検索」

写真とテキストを組み合わせて検索できる「マルチ検索」と呼ばれる機能が最近リリースされましたが、この機能が位置情報にも対応することになりました。

出典:Search your world, any way and anywhere

たとえば、マルチ検索では目の前の花の名前を知りたい時に「検索ワード」と「花の画像」で花の詳細を知ることが可能になります。

さらに今回、「Multisearch near me」と呼ばれる機能を使うことで、マルチ検索の際に位置情報を考慮し、写真とテキストにもとづいてその画像の商品や料理を取り扱う近くの店舗を検索してくれます。そのため「食べたい料理の画像×『near me(近くの)』」で検索すれば、その料理を食べることができるお店をすぐに見つけることができます。(現時点では英語での入力にのみ対応しているようです)

マルチ検索が与える写真素材の重要性

マルチ検索はとくに旅行など、観光客にとって便利であると考えられます。ネットで見つけた名前のわからないカルチャーやモノ、料理があった場合、その画像を使ってマルチ検索すれば、近くのレストランが表示されたり、場所やモノを特定することができます。今までよりも「写真」などイメージから引き出される情報がより重要となるかもしれません。

注目機能4)Googleアシスタントとの自然な会話と脱「OK, Google」

AI機能がさらに進化した「Google アシスタント」の新機能。おもに強化されたのは会話に含まれるニュアンスを理解し、「より自然な会話」ができること。具体的に言えば、「OK Google」といったウェイクワードを言う必要がなく、アシスタントとの会話が成立するよう、正確に認識するようシステムが設計されています。

出典:Look and Talk on Nest Hub Max | Google Assistant

スマートディスプレイ「Google Nest Hub Max」に搭載された「Look and Talk」という新機能は、音声アシスタントとの会話がより自然なものになることを目指しています。最大1.5メートルの距離からその人の顔や声、視線などを把握するため、ウェイクワードを言わなくてもユーザーがデバイスのほうを見ていることを認識し、会話を開始できます。まるで人と話しているような感覚に近づいたと言えるでしょう。

「Nest Hub Max」の新機能「Look and Talk」は、「Face Match」と「Voice Match」を用いて認識するため、他人に操作される心配がありません。まずはアメリカでの提供を開始し、順次そのほかへと展開されるようです。(音声の領域のデザインや課題事項については以前の記事でも触れていますのでご参照ください)

目機能5)AIによる文書の要約機能

GoogleドキュメントやGoogle Meetに、要約機能が組み込まれるようです。長い文書の内容をAIが自然言語処理を使い重要なポイントと判断したものを集約・要約してまとめてくれるというもの。

出典:Google Keynote (Google I/O ‘22)

これはドキュメントにとどまらず、Google Meetでも活用できるようになり、ミーティングの会話のハイライトを確認できるようになります。

昨年すでに実装されたYoutubeの自動チャプター機能は、関心の高い部分や重要な部分を検知しチャプターを作成するというものでした。進化し続けるAIやアルゴリズムを活用し、ユーザーの制作にかかる時間を大幅に短縮しています。

次期モバイルOS「Android 13」はどうなる!?

「Google I/O」の開催にあわせて、次期モバイルOS「Android 13」のベータプログラム「Android 13 Beta 2」が公開されました。Androidの次期バージョンについての詳細がいくつか明らかにされました。「Android 13」が利用可能になれば、モバイルデバイスのセキュリティが強化され、より安全に、そして周囲のほかのデバイスとの相互運用性が高まるとしています。Androidのプロダクトマネジメント担当のSameer Samat氏は次のように語っています。

ウォッチやタブレットあらゆる形態に拡張すること

デバイスを適切に連動させて問題を解決し一日中役立つようにすること

「セキュリティとプライバシー」機能の強化では、アプリ内のユーザーが共有する個人情報を細かく管理できるようにし、アプリからのデータアクセスやその権限を最小限にしていくということです。

そのほか現時点でもさまざまな機能が発表されていますが、Android 13の詳細については、正式リリースが近いタイミングであらためて考察できればと思います。

さらなる便利さと愛着を パーソナル化されたポケットの中のスーパーコンピュータ

ここまでお伝えしてきましたが、たくさんの新機能がリリースされ、アップデートにより快適かつ便利なものへと進化していることがおわかりいただけたのではないでしょうか。これはGoogleだけでなく、AppleのiOSも含め今後さらに進化し、展開していくことの表れではないかと感じています。

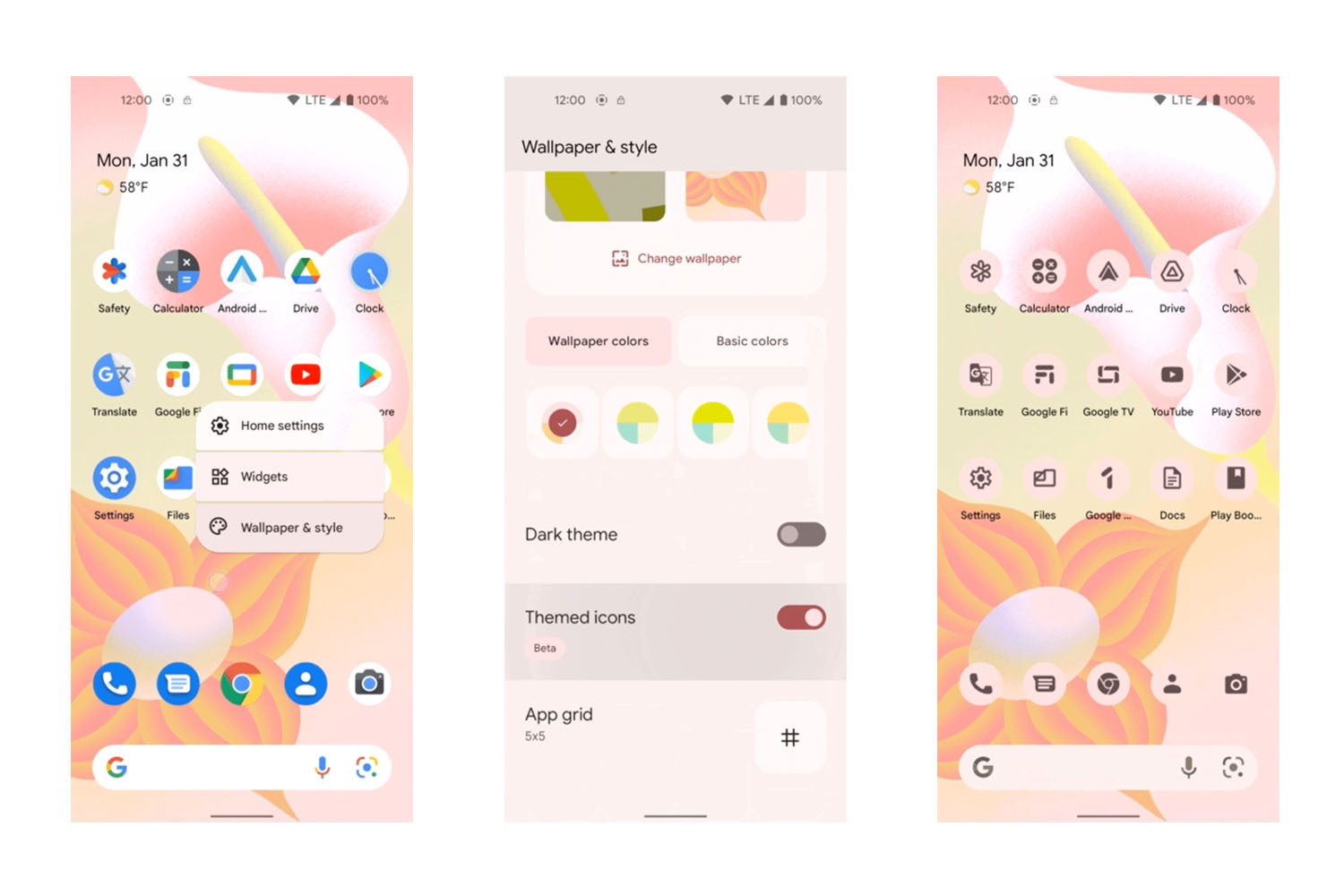

「Android 13」ではMateral Youをデザイン言語のベースとし、好みのスタイルに合わせ、スマートフォンをより自由に設定することができます。すべてのアプリアイコンにカラーテーマを組み込むことができたり、新しいメディアコントロールでは音楽に合わせて外観も変化。さらにはアプリごとに異なる言語を設定することも可能だと言います。これはたとえばマルチリンガルの方が、ソーシャルメディアと銀行アプリとで言語を使い分けることなどを想定しているのでしょう。

出典:機能と API の概要 | Android 13 デベロッパー プレビュー | Android Developers

また、個人情報を使わずに最適な広告を表示するために、個人情報を極力使わないようにしながら、各ユーザーにパーソナライズした広告を表示するための取り組みも発表されました。

そのための機能のひとつとして、年内に導入予定の新しい「My Ad Center」があります。My Ad Centerを使うことで、ユーザーは広告体験をコントロールし、ブランドをフォローできるようになります。たとえば検索やYouTubeなどで表示される広告のカテゴリーなどを簡単に設定できるようになるのです。

これらのパーソナライズオプションは、My Ad Centerの管理画面や、広告自体から直接アクセスすることができるようになるとのことです。

まとめ

「Google I/O 22」ではここで紹介した機能以外にも、たくさんの新機能やソフトウェアのアップデートがリリースされています。

今回は割愛しましたが、Google翻訳に24ヵ国語が追加となったり、自分の肌色(スキントーン)に絞って検索できる「Skin Tone」、実際のクレジットカード番号を個別の仮想番号に置き換えてセキュリティが強化される仮想のクレジットカード、デバイスではPixel 7やPixel Watch、ARグラスなどもたくさんありました。

このような便利な機能が日々アップデートされる中で、Googleが重きを置いているのは、常に意識されているセキュリティの強化、そして革新的な機能でさえもユーザーのパーソナルに寄り添い「愛着」と「手軽さ」の要素をポケットの中に収めようとしていることです。

最先端のテクノロジーなど今後の進化はもちろん楽しみですが、そこには常に「人」のためにサービスやプロダクトをつくっていくべきだという信念が感じられます。UXデザインを考える上で、ユーザーのストーリーにどのように新しい価値を提供していくか、寄り添うことができるかが大切だと感じます。

次回は、6月6日から開催されたAppleのWWDC 2022で発表された、次期OSや新機能がもたらすUIUXデザインにフォーカスして考察していきたいと思います。

以上、新谷でした。ありがとうございました!!

こちらの記事もおすすめです

様々なサービスやプラットフォームを通じて、UIUXデザイン関連の考察を連載しています。ぜひこちらもご覧ください。

CreatorZine

今回の記事はウェブマガジン「CreatorZine(クリエイタージン)」さんに寄稿させていただいた記事の追記、更新版となります。企業で働くクリエイターをサポートするウェブマガジンです。こちらもどうぞご覧ください。

Contact

各種デザインやイラスト制作承ります!お気軽にお問い合わせください。